你可能曾经用过各种AI产品,比如妙鸭相机、Kimi和ChatGPT等,让AI帮你完成各种任务。但是,现在你需要注意了,你与AI的对话可能已经不再安全了。以色列本·古里安大学的研究人员发现了一种攻击AI的方法,可以让他人窃取你与AI的对话内容,包括你的隐私、他人的隐私以及商业机密等。

这种攻击方法并不是直接破解密码,而是利用所谓的测信道攻击,通过分析时间、电磁、声音、电源等信息来推测敏感信息。这种方法对于以ChatGPT为代表的AI聊天助手来说几乎没有招架之力,唯一的例外是谷歌的Gemini。那么这种攻击方法到底是怎么回事?为什么谷歌能够独善其身呢?让我们一起来详细了解。

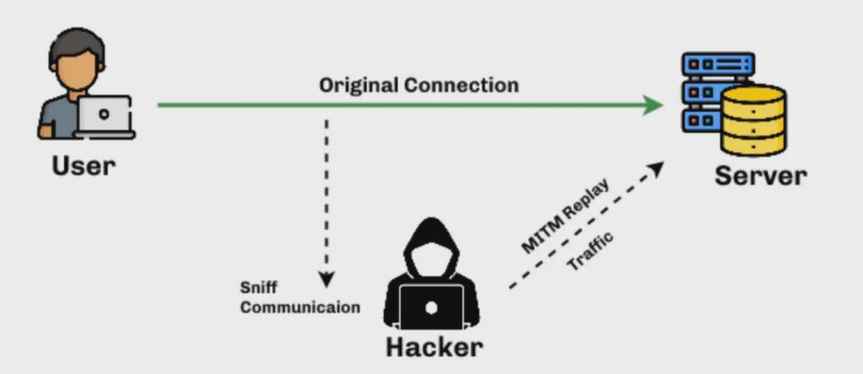

你发现你的对象最近神神秘秘地经常使用ChatGPT,但又不愿意让你看到聊天内容。你想知道他有什么不可告人的秘密,于是尝试拦截他的聊天记录。首先,你需要控制家里的路由器,以便拦截经过路由器的数据。当你成功截获数据后,你会发现ChatGPT与你对象之间的通话是加密的,这让你无法直接破解。

但是,不要慌,还有办法。你可以记录下每个数据包的长度,从而了解ChatGPT发给你对象的话是由多长的词语组成的。这样一来,你就知道了他们的对话节奏。接下来,你可以利用一个大语言模型,根据对话节奏预测具体的文本内容。这种方法虽然不是百分之百准确,但在很多情况下可以破解出关键信息。

在以色列研究人员的演示中,他们使用大语言模型成功破解了ChatGPT的加密对话内容。尽管破解的准确率并不是百分之百,但在实际应用中,获取关键信息已经足够重要。这种侧信道攻击对于大多数AI聊天助手来说都是一个巨大的安全隐患,只有谷歌的Gemini能够在一定程度上抵御这种攻击。

然而,Gemini的工作方式也存在一定的问题,会影响用户体验。除了Gemini之外,还有一种“填充”数据包的方法可以一定程度上防止这种攻击,但同样会���响用户体验。在AI技术飞速发展的今天,安全问题往往被忽视,但这并不意味着它会消失。因此,我们需要重视AI与隐私安全之间的平衡,以避免潜在的风险和危害。