Champ首发开源,人体视频生成新SOTA,5天斩获1k星,demo可玩。近日,阿里、复旦大学、南京大学联合发布的可控人体视频生成工作Champ在全网引起轰动。该模型仅开源5天GitHub即收获1k星,在Twitter更是「火出圈」,吸引了大量博主二创,浏览量总量达到300K。

Champ已经开源推理代码与权重,用户可以直接从Github上下载使用。官方Hugging Face的Demo已经上线,封装的Champ-ComfyUI也正在同步推进中。GitHub主页显示团队将会在近期开源训练代码及数据集,感兴趣的小伙伴可以持续关注项目动态。

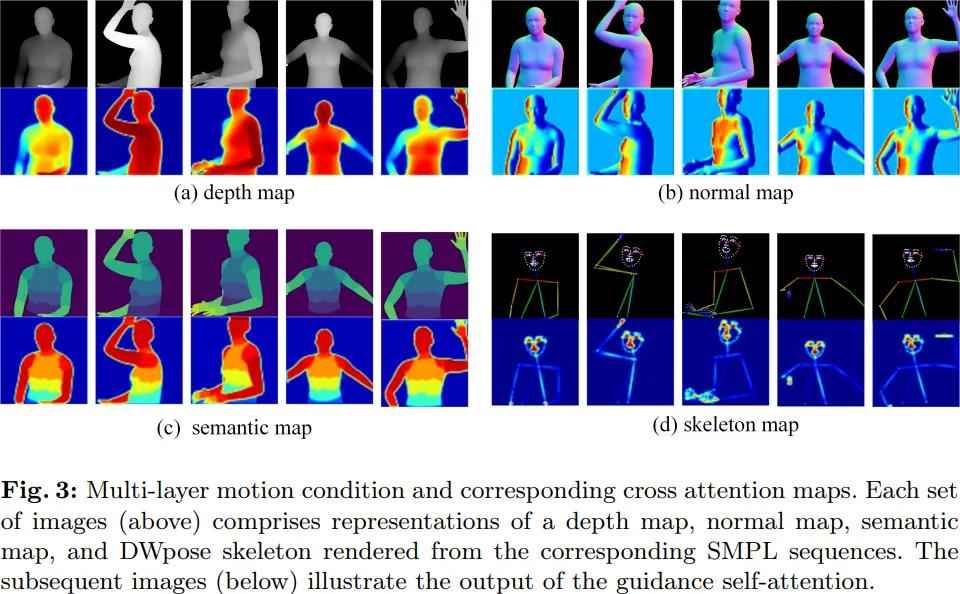

Champ利用先进的人体网格恢复模型,从输入的人体视频中提取出对应的参数化三维人体网格模型SMPL序列,进一步从中渲染出对应的深度图、法线图、人体姿态与人体语义图,作为对应的运动控制条件去指导视频生成,将动作迁移到输入的参考人像上,能够显著地提升人体运动视频的质量,以及几何和外观一致性。

Champ采用了一个多层运动融合模块(MLMF),利用自注意力机制充分融合不同条件之间的特性,实现更为精细化的运动控制。该模块不同条件的注意力可视化结果展示了深度图关注人物形态的几何轮廓信息,法线图指示人体的朝向,语义图控制人体不同部分的外观对应关系,而人体姿态骨架则仅关注于人脸与手部的关键点细节。

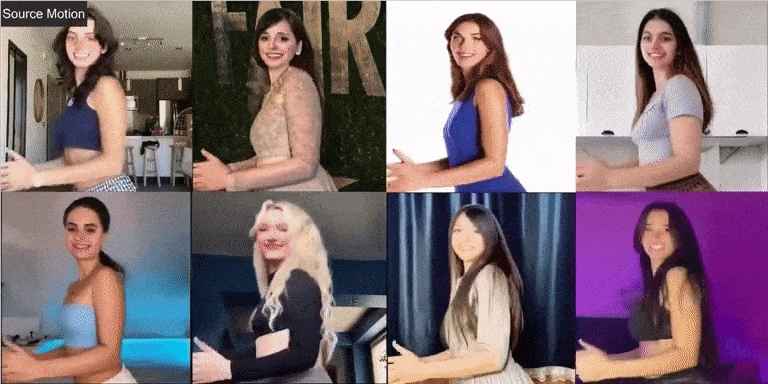

Champ解决了人体视频生成中一直被忽略的体型迁移问题。利用SMPL中体型参数,将其与驱动视频的SMPL序列进行参数化的体型对齐,从而在体型、动作上取得最佳的一致性。

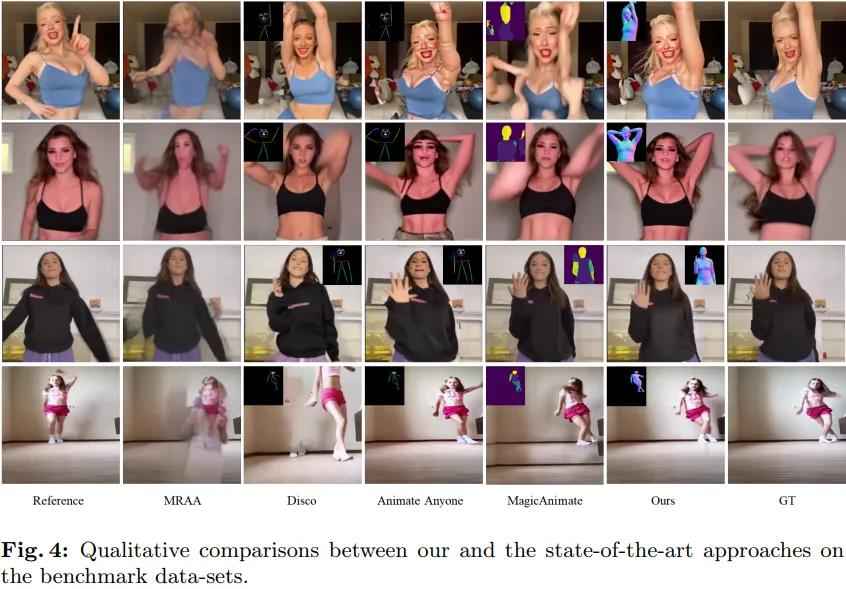

实验结果显示,与其他SOTA工作相比,Champ具有更好的运动控制以及更少的伪影。在TikTok Dance数据集上,Champ评估了图像生成与视频生成的量化效果,表现出较大的提升。

Champ在不同类型的图像上展现了强大的泛化能力,黑白照片、油画、水彩画等效果拔群。在不同文生图模型生成的真实感图像,虚拟人物也不在话下。技术细节和实验结果详见Champ原论文与代码,也可在HuggingFace或下载官方源码动手体验。